728 x 90 px

En AWS re:Invent, Amazon Web Services, Inc. (AWS), una empresa de Amazon.com, Inc. (NASDAQ: AMZN), anunció hoy tres nuevas instancias de Amazon Elastic Compute Cloud (Amazon EC2) con tecnología de tres nuevas instancias diseñadas por AWS chips que ofrecen a los clientes un rendimiento informático aún mayor a un costo menor para una amplia gama de cargas de trabajo. Las instancias Hpc7g, con la tecnología de los nuevos chips Graviton3E de AWS, ofrecen hasta 2 veces mejor rendimiento de punto flotante en comparación con las instancias C6gn de la generación actual y hasta un 20 % más de rendimiento en comparación con las instancias Hpc6a de la generación actual, lo que ofrece la mejor relación precio-rendimiento para computación de alto rendimiento (HPC ) cargas de trabajo en AWS. Las instancias C7gn, que cuentan con las nuevas tarjetas Nitro de AWS, ofrecen hasta el doble de ancho de banda de red y hasta un 50 % más de rendimiento de procesamiento de paquetes por segundo en comparación con las instancias optimizadas para redes de la generación actual. brindando el ancho de banda de red más alto, el rendimiento de tasa de paquetes más alto y el mejor rendimiento de precio para cargas de trabajo intensivas en red. Las instancias Inf2, con la tecnología de los nuevos chips Inferentia2 de AWS, están diseñadas específicamente para ejecutar los modelos de aprendizaje profundo más grandes con hasta 175 000 millones de parámetros y ofrecen hasta 4 veces más rendimiento y una latencia hasta 10 veces menor en comparación con las instancias Inf1 de la generación actual, lo que brinda la menor latencia al costo más bajo para la inferencia de aprendizaje automático (ML) en Amazon EC2.

AWS tiene una década de experiencia en el diseño de chips desarrollados para rendimiento y escalabilidad en la nube a un costo menor. En ese momento, AWS introdujo diseños de chips especializados, que hacen posible que los clientes ejecuten cargas de trabajo aún más exigentes con características variables que requieren un procesamiento más rápido, mayor capacidad de memoria, entrada/salida (I/O) de almacenamiento más rápida y mayor ancho de banda de red. Desde la introducción del sistema Nitro de AWS en 2013, AWS ha desarrollado varias innovaciones de silicio diseñadas por AWS, incluidas cinco generaciones del sistema Nitro, tres generaciones de chips Graviton optimizados para rendimiento y costo para una amplia variedad de cargas de trabajo, dos generaciones de Inferentia chips para inferencia ML y chips Trainium para entrenamiento ML. AWS utiliza la automatización del diseño electrónico basada en la nube como parte de un ciclo de desarrollo ágil para el diseño y la verificación del silicio diseñado por AWS, lo que permite a los equipos innovar más rápido y hacer que los chips estén disponibles para los clientes con mayor rapidez. AWS ha demostrado que puede ofrecer un nuevo chip basado en un proceso de silicio más moderno y de bajo consumo a un ritmo rápido y predecible.

Con cada chip sucesivo, AWS ofrece una función de mejora gradual en el rendimiento, el costo y la eficiencia de las instancias de Amazon EC2 que los alojan, lo que brinda a los clientes aún más opciones de combinaciones de chips e instancias optimizadas para sus requisitos únicos de carga de trabajo. proceso de silicio de bajo consumo energético a un ritmo rápido y predecible. Con cada chip sucesivo, AWS ofrece una función de mejora gradual en el rendimiento, el costo y la eficiencia de las instancias de Amazon EC2 que los alojan, lo que brinda a los clientes aún más opciones de combinaciones de chips e instancias optimizadas para sus requisitos únicos de carga de trabajo. proceso de silicio de bajo consumo energético a un ritmo predecible y rápido. Con cada chip sucesivo, AWS ofrece una función de mejora gradual en el rendimiento, el costo y la eficiencia de las instancias de Amazon EC2 que los alojan, lo que brinda a los clientes aún más opciones de combinaciones de chips e instancias optimizadas para sus requisitos únicos de carga de trabajo.

(Automático aquí)

“Cada generación de silicio diseñado por AWS, desde chips Graviton hasta Trainium e Inferentia hasta tarjetas Nitro, ofrece niveles crecientes de rendimiento, menor costo y eficiencia energética para una amplia gama de cargas de trabajo de los clientes”, dijo David Brown, vicepresidente de Amazon EC2. en AWS. “Esa entrega consistente, combinada con las capacidades de nuestros clientes para lograr un rendimiento de precio superior utilizando el silicio de AWS, impulsa nuestra innovación continua. Las instancias de Amazon EC2 que presentamos hoy ofrecen mejoras significativas para las cargas de trabajo de inferencia de aprendizaje automático, uso intensivo de redes y HPC, lo que brinda a los clientes aún más instancias para elegir para satisfacer sus necesidades específicas”.

Las instancias de HPC7g están diseñadas específicamente para ofrecer el mejor rendimiento de precio para ejecutar cargas de trabajo de HPC a escala en Amazon EC2

Organizaciones de numerosos sectores confían en HPC para resolver sus problemas académicos, científicos y empresariales más complejos. En la actualidad, clientes como AstraZeneca, Formula 1 y Maxar Technologies ejecutan cargas de trabajo de HPC convencionales como procesamiento de genómica, dinámica de fluidos computacional (CFD) y simulaciones de pronóstico del tiempo en AWS para aprovechar la seguridad, la escalabilidad y la elasticidad superiores que ofrece. Los ingenieros, investigadores y científicos ejecutan sus cargas de trabajo de HPC en instancias optimizadas para la red de Amazon EC2 (por ejemplo, C5n, R5n, M5n y C6gn) que brindan una capacidad informática prácticamente ilimitada y altos niveles de ancho de banda de red entre servidores que procesan e intercambian datos entre miles. de núcleos. Si bien el rendimiento de estas instancias es suficiente para la mayoría de los casos de uso de HPC en la actualidad,

Las instancias Hpc7g con la tecnología de los nuevos procesadores Graviton3E de AWS ofrecen el mejor rendimiento de precio para las cargas de trabajo de HPC de los clientes (por ejemplo, CFD, simulaciones climáticas, genómica y dinámica molecular) en Amazon EC2. Las instancias Hpc7g brindan hasta 2 veces mejor rendimiento de punto flotante en comparación con las instancias C6gn de la generación actual con tecnología de procesadores Graviton2 y hasta un 20 % más de rendimiento en comparación con las instancias Hpc6a de la generación actual, lo que permite a los clientes realizar cálculos complejos en clústeres HPC de hasta decenas de miles. de núcleos.

Las instancias hpc7g también proporcionan ancho de banda de memoria alta y 200 Gbps de ancho de banda de red de adaptador de tejido elástico (EFA) para lograr resultados más rápidos para las aplicaciones de HPC. Los clientes pueden usar instancias Hpc7g con AWS ParallelCluster, una herramienta de administración de clústeres de código abierto, para aprovisionar instancias de HPc7g junto con otros tipos de instancias, brindando a los clientes la flexibilidad de ejecutar diferentes tipos de cargas de trabajo dentro del mismo clúster de HPC.

Las instancias C7gn ofrecen el mejor rendimiento para cargas de trabajo intensivas en la red con mayor ancho de banda de red, mayor rendimiento de tasa de paquetes y menor latencia

Los clientes utilizan instancias optimizadas para la red de Amazon EC2 para ejecutar sus cargas de trabajo intensivas en la red más exigentes, como dispositivos virtuales de red (por ejemplo, firewalls, enrutadores virtuales y balanceadores de carga) y cifrado de datos. Los clientes necesitan escalar el rendimiento de estas cargas de trabajo para manejar el aumento del tráfico de red en respuesta a los picos de actividad, o reducir el tiempo de procesamiento para brindar una mejor experiencia a sus usuarios finales. Hoy en día, los clientes usan tamaños de instancia más grandes para obtener un mayor rendimiento de la red, implementando más recursos informáticos de los necesarios, lo que aumenta los costos. Estos clientes necesitan un mayor rendimiento de paquetes por segundo, mayor ancho de banda de red y un rendimiento criptográfico más rápido para reducir los tiempos de procesamiento de datos.

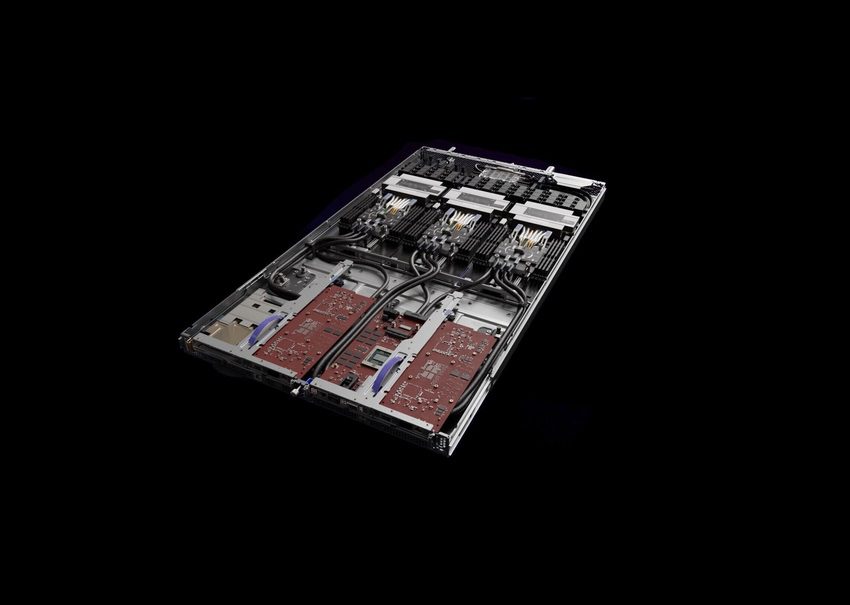

Las instancias C7gn, que cuentan con nuevas tarjetas AWS Nitro con tecnología de nuevos chips Nitro de quinta generación con aceleración de red, ofrecen el ancho de banda de red y el rendimiento de procesamiento de paquetes más altos en todas las instancias optimizadas para la red de Amazon EC2, al tiempo que consumen menos energía. Las tarjetas Nitro descargan y aceleran las funciones de E/S desde la CPU host al hardware especializado para entregar prácticamente todos los recursos de una instancia de Amazon EC2 a las cargas de trabajo del cliente para un rendimiento más consistente con una menor utilización de la CPU. Las nuevas tarjetas Nitro de AWS permiten que las instancias C7gn ofrezcan hasta el doble del ancho de banda de la red y hasta un 50 % más de rendimiento de procesamiento de paquetes por segundo, y una latencia de red reducida del adaptador de tela elástica (EFA) en comparación con las instancias Amazon EC2 optimizadas para redes de la generación actual .

Las instancias C7gn ofrecen hasta un 25 % más de rendimiento informático y un rendimiento hasta dos veces más rápido para cargas de trabajo criptográficas en comparación con las instancias C6gn. Las tarjetas Nitro de quinta generación también ofrecen un 40 % más de rendimiento por vatio en comparación con las tarjetas Nitro de cuarta generación, lo que reduce el consumo de energía para las cargas de trabajo de los clientes. Las instancias C7gn permiten a los clientes escalar tanto para el rendimiento como para reducir la latencia de la red para optimizar el costo de sus cargas de trabajo más exigentes y con uso intensivo de la red en Amazon EC2. Las instancias C7gn están disponibles hoy en versión preliminar. Para obtener más información sobre las instancias C7gn, visite Las instancias C7gn permiten a los clientes escalar tanto para el rendimiento como para reducir la latencia de la red para optimizar el costo de sus cargas de trabajo más exigentes y con uso intensivo de la red en Amazon EC2. Las instancias C7gn están disponibles hoy en versión preliminar. Para obtener más información sobre las instancias C7gn, visite Las instancias C7gn permiten a los clientes escalar tanto para el rendimiento como para reducir la latencia de la red para optimizar el costo de sus cargas de trabajo más exigentes y con uso intensivo de la red en Amazon EC2. Las instancias C7gn están disponibles hoy en versión preliminar.

Las instancias de Inf2 están diseñadas específicamente para servir a las implementaciones de modelos de aprendizaje profundo más exigentes de la actualidad, con soporte para inferencia distribuida y redondeo estocástico.

En respuesta a la demanda de mejores aplicaciones e incluso experiencias personalizadas más personalizadas, los científicos de datos y los ingenieros de ML están creando modelos de aprendizaje profundo más grandes y complejos. Por ejemplo, los modelos de lenguaje grande (LLM) con más de 100 mil millones de parámetros son cada vez más frecuentes, pero se entrenan con enormes cantidades de datos, lo que impulsa un crecimiento sin precedentes en los requisitos informáticos. Si bien la capacitación recibe mucha atención, la inferencia representa la mayor parte de la complejidad y el costo (es decir, por cada $ 1 gastado en capacitación, se gastan hasta $ 9 en inferencia) de ejecutar el aprendizaje automático en producción, lo que puede limitar su uso y detener al cliente. innovación. Los clientes desean utilizar modelos de aprendizaje profundo de última generación en sus aplicaciones a escala, pero se ven limitados por los altos costos de cómputo.

Cuando AWS lanzó las instancias Inf1 en 2019, los modelos de aprendizaje profundo eran millones de parámetros. Desde entonces, el tamaño y la complejidad de los modelos de aprendizaje profundo han crecido exponencialmente y algunos modelos de aprendizaje profundo superan cientos de miles de millones de parámetros, un aumento de 500 veces. Los clientes que trabajan en aplicaciones de próxima generación que utilizan los últimos avances en aprendizaje profundo desean hardware rentable y eficiente en energía que admita baja latencia, inferencia de alto rendimiento, con software flexible que permita a los equipos de ingeniería implementar rápidamente sus últimas innovaciones a escala.

Las instancias Inf2, con la tecnología de los nuevos chips Inferentia2, admiten grandes modelos de aprendizaje profundo (p. ej., LLM, generación de imágenes y detección de voz automatizada) con hasta 175 000 millones de parámetros, al tiempo que ofrecen el costo por inferencia más bajo en Amazon EC2. Inf2 es la primera instancia de Amazon EC2 optimizada para inferencia que admite inferencia distribuida, una técnica que distribuye modelos grandes en varios chips para ofrecer el mejor rendimiento para modelos de aprendizaje profundo con más de 100 000 millones de parámetros. Las instancias de Inf2 admiten el redondeo estocástico, una forma de redondeo probabilístico que permite un alto rendimiento y una mayor precisión en comparación con los modos de redondeo heredados. Las instancias Inf2 admiten una amplia gama de tipos de datos, incluidos CFP8, que mejora el rendimiento y reduce el consumo por inferencia, y FP32, lo que aumenta el rendimiento de los módulos que aún no han aprovechado los tipos de datos de menor precisión.

Los clientes pueden comenzar con las instancias Inf2 utilizando AWS Neuron, el kit de desarrollo de software (SDK) unificado para la inferencia de ML. AWS Neuron está integrado con marcos de ML populares como PyTorch y TensorFlow para ayudar a los clientes a implementar sus modelos existentes en instancias Inf2 con cambios mínimos en el código. Dado que la división de modelos grandes en varios chips requiere una comunicación rápida entre chips, las instancias Inf2 son compatibles con la interconexión entre instancias de alta velocidad de AWS, NeuronLink, que ofrece 192 GB/s de conectividad en anillo. Las instancias Inf2 ofrecen hasta 4 veces el rendimiento y hasta 10 veces menos latencia en comparación con las instancias Inf1 de la generación actual, y también ofrecen hasta un 45 % más de rendimiento por vatio en comparación con las instancias basadas en GPU. Las instancias de Inf2 están disponibles hoy en versión preliminar. Para obtener más información sobre las instancias de Inf2, visiteaws.amazon.com/ec2/instance-types/inf2 .

El Instituto del Agua es una organización de investigación aplicada independiente y sin fines de lucro que trabaja en todas las disciplinas para hacer avanzar la ciencia y desarrollar métodos integrados que se utilizan para resolver desafíos ambientales y sociales complejos. “La capacidad de hacer predicciones meteorológicas numéricas precisas casi en tiempo real para ayudar en la toma de decisiones es importante para nuestros clientes. Estamos entusiasmados de ver que las ofertas informáticas de alto rendimiento de Amazon EC2 continúan evolucionando con el lanzamiento de las instancias Amazon EC2 Hpc7g”, dijo Zach Cobell, ingeniero de investigación de The Water Institute. “Con un mayor rendimiento de punto flotante, una mayor eficiencia con los procesadores AWS Graviton3E, basados en la arquitectura Arm, y una menor latencia entre nodos con el adaptador Elastic Fabric, esperamos seguir ofreciendo soluciones innovadoras y sostenibles en toda nuestra cartera informática”.

Arup es un colectivo global de diseñadores, consultores, asesores y expertos en ingeniería y sostenibilidad dedicados al desarrollo sostenible y al uso de la imaginación, la tecnología y el rigor para dar forma a un mundo mejor. “Usamos AWS para ejecutar simulaciones altamente complejas para ayudar a nuestros clientes a construir la próxima generación de edificios de gran altura, estadios, centros de datos e infraestructura crucial, además de evaluar y brindar información sobre los microclimas urbanos, el calentamiento global y el cambio climático. eso afecta la vida de tantas personas en todo el mundo”, dijo la Dra. Sina Hassanli, ingeniera senior de Arup. “Nuestros clientes exigen constantemente simulaciones más rápidas y precisas a un menor costo para informar sus diseños en las primeras etapas de desarrollo.

HAProxy Technologies es la empresa detrás de HAProxy, el equilibrador de carga de software más rápido y más utilizado del mundo. «HAProxy impulsa la entrega de aplicaciones modernas a cualquier escala y en cualquier entorno, brindando el máximo rendimiento, visibilidad y seguridad para algunos de los sitios web más populares del mundo», dijo Willy Tarreau, desarrollador principal de HAProxy. «Cuando HAProxy probó Amazon EC2 «Instancias C6gn, encontramos un rendimiento sin precedentes para un balanceador de carga de software. Estamos entusiasmados con las nuevas instancias C7gn con Graviton3E y las tarjetas AWS Nitro de quinta generación y las mejoras en el rendimiento de la red que traerán a nuestros clientes».

La plataforma de datos en tiempo real de Aerospike Inc. está diseñada para que las organizaciones creen aplicaciones que combatan el fraude, permitan pagos digitales globales, brinden experiencias de usuario hiperpersonalizadas a decenas de millones de clientes y más. “La plataforma de datos en tiempo real de Aerospike es una plataforma de datos multimodal, multiproceso y sin uso compartido, diseñada para operar de manera eficiente en un grupo de nodos de servidor, aprovechando el hardware moderno y las tecnologías de red para impulsar un rendimiento rápido y confiable a velocidades de submilisegundos en petabytes de datos. ”, dijo Lenley Hensarling, director de productos de Aerospike. “En nuestras recientes pruebas de lectura de bases de datos en tiempo real, nos complació ver una mejora significativa en las transacciones por segundo en las instancias C7gn de Amazon EC2 con las nuevas tarjetas Nitro de AWS en comparación con las instancias C6gn.

Qualtrics diseña y desarrolla software de gestión de experiencias. “En Qualtrics, nuestro enfoque es desarrollar tecnología que cierre las brechas de experiencia para clientes, empleados, marcas y productos. Para lograrlo, estamos desarrollando modelos complejos de aprendizaje profundo multimodal y multitarea para lanzar nuevas funciones, como clasificación de texto, etiquetado de secuencias, análisis de discurso, extracción de frases clave, extracción de temas, agrupación y análisis de extremo a extremo. comprensión de conversaciones”, dijo Aaron Colak, director de Core Machine Learning en Qualtrics. “A medida que utilizamos estos modelos más complejos en más aplicaciones, el volumen de datos no estructurados crece y necesitamos soluciones optimizadas por inferencia de mayor rendimiento que puedan satisfacer estas demandas, como instancias Inf2, para brindar las mejores experiencias a nuestros clientes. Estamos entusiasmados con las nuevas instancias de Inf2,

Finch Computing es una empresa de tecnología de lenguaje natural que proporciona aplicaciones de inteligencia artificial para clientes del gobierno, servicios financieros e integradores de datos. “Para satisfacer las necesidades de procesamiento de lenguaje natural en tiempo real de nuestros clientes, desarrollamos modelos de aprendizaje profundo de última generación que se adaptan a grandes cargas de trabajo de producción. Tenemos que proporcionar transacciones de baja latencia y lograr un alto rendimiento para procesar fuentes de datos globales. Ya migramos muchas cargas de trabajo de producción a instancias Inf1 y logramos una reducción del 80 % en el costo de las GPU”, dijo Franz Weckesser, arquitecto jefe de Finch Computing. “Ahora, estamos desarrollando modelos más grandes y complejos que permiten un significado más profundo y perspicaz del texto escrito. Muchos de nuestros clientes necesitan acceder a esta información en tiempo real y el rendimiento de las instancias Inf2 nos ayudará a ofrecer una latencia más baja y un rendimiento más alto que Inf1. Con las mejoras de rendimiento de Inf2 y las nuevas funciones de Inf2, como la compatibilidad con tamaños de entrada dinámicos, estamos mejorando nuestra rentabilidad, elevando la experiencia del cliente en tiempo real y ayudando a nuestros clientes a obtener nuevos conocimientos de sus datos”.

Amante de la tecnología con 7 años de experiencia en el cubrimiento informativo de este sector en temas como telecomunicaciones, tecnología de consumo, dispositivos móviles y plataformas en Colombia.

Mi opinión sobre tecnología ha sido tomada por medios como La República o AS. Soy especialista productos de consumo masivo y reviews de hardware. Soy director de tecnogus.com.co