728 x 90 px

ASUS, la empresa de TI líder en sistemas de servidores, placas base para servidores y estaciones de trabajo, publicó hoy sus resultados por primera vez desde que se unió a la Asociación MLCommons en diciembre pasado, estableciendo instantáneamente nuevos récords de rendimiento en docenas de tareas evaluadas. .

Específicamente, en la última ronda de MLPerf Inference 2.0, los servidores ASUS establecieron 26 récords en la división cerrada del centro de datos en seis tareas de referencia de IA, superando a todos los demás servidores con las mismas configuraciones de GPU. Los logros consisten en 12 récords logrados con un servidor ASUS ESC8000A-E11 configurado con ocho GPU NVIDIA® A100 Tensor Core de 80GB; y 14 registros con un servidor ASUS ESC4000A-E11 con cuatro GPU NVIDIA A30 Tensor Core de 24 GB.

Estos resultados revolucionarios demuestran claramente el dominio del rendimiento de los servidores ASUS en el ámbito de la IA, lo que aporta un valor significativo a las organizaciones que buscan implementar IA y garantiza un rendimiento óptimo en los centros de datos.

(Automático aquí)

ASUS estableció 26 récords en inferencia de IA y domina las tablas de resultados en seis tareas

El punto de referencia MLPerf Inference 2.0 cubre seis cargas de trabajo comunes de inferencia de IA, que incluyen clasificación de imágenes (ResNet50), detección de objetos (SSD-ResNet34), segmentación de imágenes médicas (3D-Unet), reconocimiento de voz (RNN-T), procesamiento de lenguaje natural (BERT). ) y recomendación (DLRM).

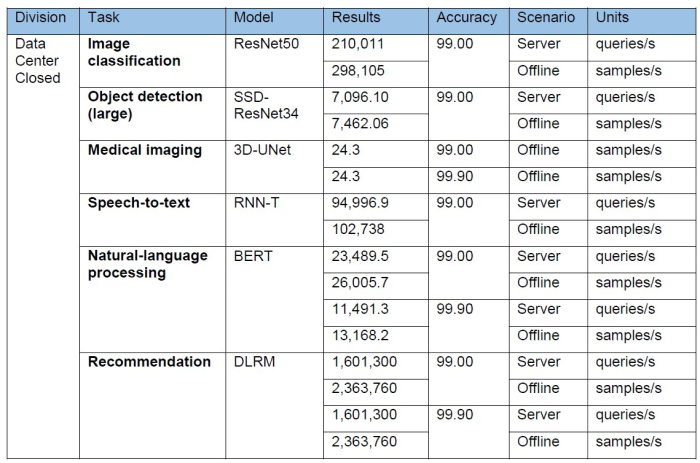

ESC8000A-E11 ha logrado múltiples posiciones de liderazgo en rendimiento, que incluyen:

– Clasificación de 298.105 imágenes procesadas por segundo en ResNet50

– Completó el reconocimiento de objetos de 7.462,06 imágenes por segundo en SSD-ResNet34

– Procesó 24,3 imágenes médicas por segundo en 3D-UNet

– 26.005,7 preguntas y respuestas completadas por segundo en BERT

– Completó 2 363 760 predicciones de clics por segundo en DLRM

Tabla de resultados ESC8000A-E11

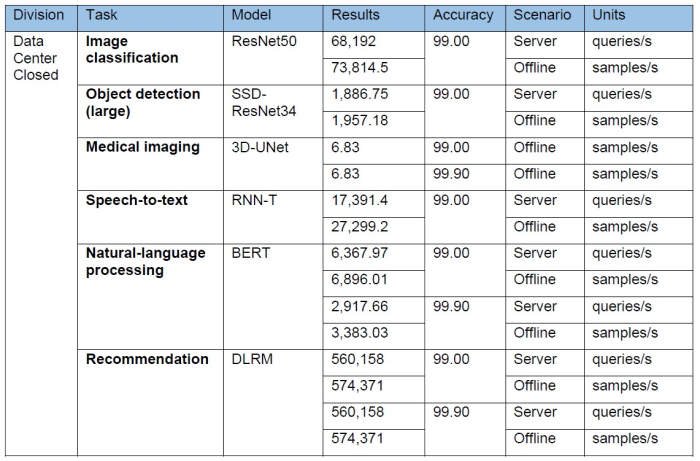

ESC4000A-E11 ha logrado múltiples posiciones de liderazgo en rendimiento, que incluyen:

– Clasificación de 73.814,5 imágenes procesadas por segundo en ResNet50

– Completó el reconocimiento de objetos de 1.957,18 imágenes por segundo en SSD-ResNet34

– Procesó 6,83 imágenes médicas por segundo en 3D-UNet

– Completó 27.299,2 conversiones de reconocimiento de voz por segundo en RNNT

– 6.896,01 preguntas y respuestas completadas por segundo en BERT

– Completó 574 371 predicciones de clics por segundo en DLRM

Tabla de resultados ESC4000A-E11

Mejora continua del rendimiento de la IA con un diseño de servidor optimizado

La docena de 12 récords de MLPerf Inference 2.0 establecidos por el 4U ESC8000A-E11 certificado por NVIDIA, configurado con ocho GPU NVIDIA A100 PCIe Tensor Core de 80 GB y dos CPU AMD EPYC 7763, demuestra su suprema escalabilidad para IA y aprendizaje automático. Su diseño térmico aerodinámico, con túneles de flujo de aire de CPU y GPU independientes, brinda una solución de enfriamiento de alta eficiencia a los centros de datos enfriados por aire.

El ESC4000A-E11 certificado por NVIDIA, alojado en el espacio de 2U más compacto del mercado y configurado con cuatro GPU NVIDIA A30 PCIe Tensor Core de 24 GB y dos CPU AMD EPYC 7763, estableció un total de 14 registros MPLerf Inference 2.0. Ofrece una amplia gama de aceleradores de gráficos, además de soporte para la interconexión de GPU de alta velocidad NVIDIA NVLink, para liberar el máximo rendimiento de IA.

Amante de la tecnología con 7 años de experiencia en el cubrimiento informativo de este sector en temas como telecomunicaciones, tecnología de consumo, dispositivos móviles y plataformas en Colombia.

Mi opinión sobre tecnología ha sido tomada por medios como La República o AS. Soy especialista productos de consumo masivo y reviews de hardware. Soy director de tecnogus.com.co